TF-IDF를 활용하여 문서의 핵심 키워드를 찾고, 문서 간 유사도를 측정하는 방법을 알아보세요. 텍스트 데이터 분석에 필수적인 TF-IDF 개념을 쉽고 명확하게 이해하고, 실제 활용 사례를 통해 그 유용성을 확인해 보세요.

TF-IDF란 무엇일까요?

TF-IDF는 Term Frequency-Inverse Document Frequency의 약자로, 텍스트 데이터 분석에서 자주 사용되는 가중치 기법입니다. 어떤 단어가 특정 문서에서 얼마나 중요한지를 나타내는 지표라고 생각하면 쉬워요. 즉, 특정 문서에서 자주 등장하지만, 다른 문서에서는 잘 등장하지 않는 단어일수록 높은 TF-IDF 값을 갖게 됩니다.

쉽게 말해, TF-IDF는 특정 문서에서 특정 단어가 얼마나 중요한지를 나타내는 수치를 계산하는 방법이에요. 만약 여러 개의 문서가 있고, 그 중 하나의 문서에서 "인공지능"이라는 단어가 자주 등장한다면, "인공지능"은 그 문서의 중요한 주제일 가능성이 높겠죠? TF-IDF는 바로 이러한 아이디어를 바탕으로 만들어졌습니다.

TF-IDF는 단어의 빈도(Term Frequency)와 역문서 빈도(Inverse Document Frequency) 두 가지 요소를 결합하여 계산합니다.

Term Frequency (TF)는 특정 문서 내에서 특정 단어가 얼마나 자주 등장하는지를 나타내는 값이에요. 예를 들어, 100개의 단어로 이루어진 문서에서 "인공지능"이라는 단어가 5번 등장한다면, TF는 5/100 즉, 0.05가 됩니다.

Inverse Document Frequency (IDF)는 특정 단어가 문서 집합 전체에서 얼마나 흔하게 나타나는지를 나타내는 값입니다. 특정 단어가 많은 문서에 등장할수록 IDF 값은 낮아지고, 특정 단어가 적은 문서에만 등장할수록 IDF 값은 높아집니다. 흔한 단어일수록 중요도가 낮다고 판단하는 거죠. 예를 들어, "의"나 "는" 같은 조사는 많은 문서에서 흔하게 나타나기 때문에 IDF 값이 낮을 겁니다. 반면, "딥러닝"이나 "머신러닝" 같은 전문 용어는 특정 문서에만 등장하기 때문에 IDF 값이 높아질 가능성이 높습니다.

TF-IDF 계산 공식

TF-IDF는 TF와 IDF를 곱하여 계산합니다.

TF-IDF(t, d) = TF(t, d) * IDF(t)

여기서 t는 단어, d는 문서를 의미합니다. TF-IDF 값이 높을수록 해당 단어는 특정 문서에서 더 중요하다고 판단할 수 있습니다.

TF-IDF를 활용하는 방법

TF-IDF는 다양한 분야에서 활용될 수 있어요. 텍스트 데이터 분석, 정보 검색, 문서 요약, 추천 시스템 등에서 유용하게 사용됩니다.

1. 문서 유사도 측정

TF-IDF는 두 개의 문서가 얼마나 유사한지를 측정하는 데 사용할 수 있습니다. 두 문서의 TF-IDF 벡터를 비교하여 코사인 유사도를 계산하면 두 문서의 유사도를 측정할 수 있습니다. 예를 들어, 뉴스 기사를 TF-IDF 벡터로 변환하고 코사인 유사도를 계산하면 비슷한 주제를 다루는 뉴스 기사를 찾을 수 있습니다.

2. 핵심 키워드 추출

TF-IDF는 문서의 핵심 키워드를 추출하는 데에도 유용하게 사용됩니다. 문서 내에서 TF-IDF 값이 높은 단어들을 뽑아내면, 그 문서의 주요 주제를 나타내는 핵심 키워드를 찾을 수 있습니다. 예를 들어, 논문이나 보고서에서 TF-IDF 값이 높은 단어들을 추출하여 그 문서의 주요 내용을 요약하거나, 문서를 분류하는 데 활용할 수 있습니다.

3. 검색 엔진 최적화 (SEO)

검색 엔진은 TF-IDF를 활용하여 사용자의 검색어와 관련된 문서를 찾고, 검색 결과를 순위대로 보여줍니다. 사용자의 검색어에 포함된 단어들이 문서에서 자주 등장하고, 다른 문서에서는 잘 등장하지 않는다면, 그 문서는 사용자의 검색 의도와 더 잘 맞는다고 판단하여 상위에 노출시킵니다. 웹사이트 운영자들은 TF-IDF를 활용하여 웹 페이지의 콘텐츠를 구성하고, 사용자들이 검색할 만한 키워드를 파악하여 검색 엔진 최적화에 활용할 수 있습니다.

TF-IDF의 장점과 단점

TF-IDF는 텍스트 데이터 분석에서 유용하게 활용될 수 있지만, 장점과 단점을 모두 가지고 있습니다.

1. 장점

- 단어의 중요도를 효과적으로 반영: TF-IDF는 단어의 빈도뿐만 아니라, 그 단어가 문서 집합 전체에서 얼마나 흔하게 나타나는지도 고려하기 때문에, 단어의 중요도를 더욱 효과적으로 반영할 수 있습니다.

- 간단하고 구현하기 쉽다: TF-IDF는 개념이 간단하고 계산 과정이 복잡하지 않아 쉽게 구현할 수 있습니다.

- 다양한 분야에서 활용 가능: 텍스트 데이터 분석, 정보 검색, 문서 요약, 추천 시스템 등 다양한 분야에서 활용될 수 있습니다.

2. 단점

- 의미를 고려하지 않음: TF-IDF는 단어의 빈도만을 기반으로 계산되기 때문에, 단어의 의미나 맥락은 고려하지 않습니다. 예를 들어, "사과"라는 단어는 과일을 의미할 수도 있고, 사과하는 행위를 의미할 수도 있습니다. TF-IDF는 이러한 맥락을 구분하지 못합니다.

- 불용어 처리 필요: TF-IDF는 흔한 단어(불용어)의 중요도를 낮추는 효과를 가지지만, 모든 불용어를 제거하는 것은 어렵습니다.

- 문서 길이의 영향: TF-IDF는 문서의 길이에 영향을 받을 수 있습니다. 긴 문서는 짧은 문서보다 TF 값이 높아질 가능성이 높습니다.

Python으로 TF-IDF 구현하기

Python의 Scikit-learn 라이브러리를 사용하면 TF-IDF를 쉽게 구현할 수 있어요.

from sklearn.feature_extraction.text import TfidfVectorizer

documents = [

"자연어 처리가 재미있어요.",

"머신러닝을 공부하고 싶어요.",

"텍스트 마이닝은 어려워요."

]

vectorizer = TfidfVectorizer()

tfidf_matrix = vectorizer.fit_transform(documents)

print(tfidf_matrix)

print(vectorizer.get_feature_names_out())코드에서는 를 사용하여 문서를 TF-IDF 벡터로 변환했습니다. 메서드는 문서를 벡터로 변환하고, 메서드는 사용된 단어들을 출력합니다.

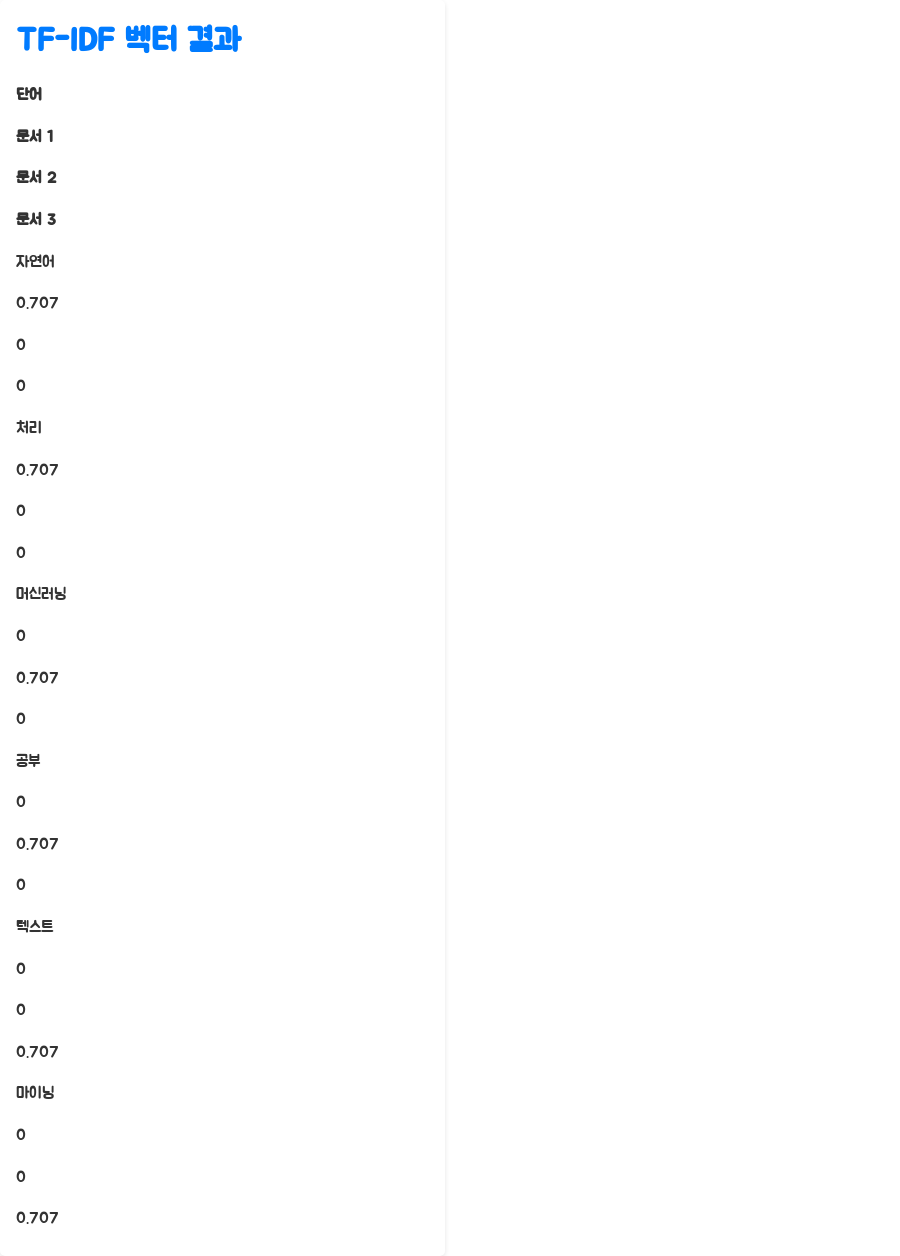

TF-IDF 벡터 결과

| 자연어 | 0.707 | 0 | 0 |

| 처리 | 0.707 | 0 | 0 |

| 머신러닝 | 0 | 0.707 | 0 |

| 공부 | 0 | 0.707 | 0 |

| 텍스트 | 0 | 0 | 0.707 |

| 마이닝 | 0 | 0 | 0.707 |

단어 문서 1 문서 2 문서 3

궁금한 점이 있으신가요?

Q1. TF-IDF는 어떤 경우에 사용하면 좋을까요?

A1. TF-IDF는 문서의 핵심 키워드를 추출하거나, 문서 간 유사도를 측정하고 싶을 때 유용합니다. 또한, 검색 엔진 최적화나 추천 시스템 구축에도 활용할 수 있습니다.

Q2. TF-IDF의 장점은 무엇인가요?

A2. TF-IDF는 단어의 중요도를 효과적으로 반영하고, 구현이 간단하며, 다양한 분야에서 활용될 수 있다는 장점이 있습니다.

Q3. TF-IDF의 단점은 무엇인가요?

A3. TF-IDF는 단어의 의미나 맥락을 고려하지 않고, 불용어 처리가 필요하며, 문서 길이의 영향을 받을 수 있다는 단점이 있습니다.

마무리

TF-IDF는 텍스트 데이터 분석에서 핵심 단어를 추출하고, 문서 간 유사도를 측정하는 데 유용한 기법입니다. Python의 Scikit-learn 라이브러리를 사용하면 쉽게 구현할 수 있고, 다양한 분야에서 활용될 수 있습니다. TF-IDF를 이해하고 활용하면, 여러분의 텍스트 데이터 분석 능력을 한층 더 발전시킬 수 있을 거에요!

키워드

TF-IDF,텍스트마이닝,자연어처리,머신러닝,데이터분석,핵심키워드추출,문서유사도,검색엔진최적화,SEO,Python,ScikitLearn,코사인유사도,IDF,TF,CountVectorizer,TfidfVectorizer,자연어처리기법,데이터과학,인공지능,NLP,텍스트분석,정보검색,추천시스템,문서요약,가중치기법,데이터마이닝,텍스트데이터,머신러닝알고리즘,데이터사이언스