딥러닝 모델이 점점 더 복잡해지고 성능이 향상되면서, 모델의 크기와 연산량 또한 기하급수적으로 증가하고 있어요. 특히 모바일 기기나 임베디드 시스템처럼 연산 능력이나 메모리 용량이 제한적인 환경에서는 모델 크기가 큰 걸림돌이 될 수밖에 없죠. 이럴 때 사용하는 게 바로 양자화(Quantization)라는 기술이에요.

양자화는 딥러닝 모델의 가중치와 활성화 값을 더 낮은 비트 수로 표현하는 기술이에요. 쉽게 말해, 32비트 부동 소수점으로 표현된 수들을 8비트나 4비트 정수로 바꿔서 모델의 크기를 줄이는 거죠. 모델 크기가 줄어들면 저장 공간을 절약할 수 있고, 더 빠르게 추론할 수도 있답니다. 마치 고해상도 사진을 압축해서 용량을 줄이는 것과 비슷하다고 생각하면 돼요.

딥러닝 모델 양자화: 모델 경량화의 핵심

딥러닝 모델 양자화는 모델 크기를 줄이고 연산 속도를 높여, 모델을 더 효율적으로 만들어 주는 핵심 기술이에요. 마치 집을 짓는 과정에서 필요 없는 벽돌을 제거해서 더 가볍고 튼튼한 집을 만드는 것과 같은 원리라고 할 수 있죠. 그럼 양자화가 딥러닝 모델에 어떤 영향을 주는지 자세히 알아볼까요?

모델 크기 줄이기: 저장 공간 절약과 빠른 배포

양자화의 가장 큰 장점 중 하나는 모델 크기를 줄여준다는 거예요. 모델 크기가 작아지면 저장 공간을 절약할 수 있고, 모델을 더 빠르게 배포할 수 있다는 장점이 생기죠. 예를 들어, 이미지 분류 모델을 모바일 앱에 탑재해야 하는 경우, 모델 크기가 크면 앱 용량이 커져 다운로드 시간이 오래 걸리고, 사용자들의 스마트폰 저장 공간을 많이 차지할 수 있어요. 하지만 양자화를 통해 모델 크기를 줄이면 앱 용량을 줄여 더 빠르게 다운로드하고 설치할 수 있답니다.

추론 속도 향상: 실시간 처리와 빠른 응답

양자화된 모델은 낮은 비트 수의 데이터를 사용하기 때문에, 연산 속도가 빨라져요. 그 결과, 추론 시간이 단축되고, 실시간 처리가 가능해진답니다. 마치 고속도로를 달리는 것처럼, 데이터 처리 속도가 빨라지면서 딥러닝 모델의 응답 시간이 빨라지는 거죠. 예를 들어, 자율주행 자동차에 탑재된 객체 인식 모델이 있다고 가정해볼게요. 양자화를 통해 모델 크기와 추론 시간을 줄이면, 자동차가 주변 환경을 더 빠르게 인식하고 반응할 수 있게 되죠.

전력 소비 감소: 배터리 효율 향상

양자화를 통해 모델 크기와 연산량이 줄어들면, 자연스럽게 전력 소비량도 감소하게 돼요. 특히 배터리 용량이 제한적인 모바일 기기나 임베디드 시스템에서 유용하죠. 마치 에너지 효율이 좋은 전구를 사용하는 것처럼, 양자화를 통해 전력 소비를 줄이고 배터리 수명을 늘릴 수 있어요. 예를 들어, 스마트폰 카메라에 탑재된 이미지 처리 모델이 있다고 생각해보세요. 양자화를 통해 모델의 전력 소비를 줄이면, 카메라를 더 오랫동안 사용할 수 있답니다.

하드웨어 호환성 향상: 다양한 기기에서 활용

양자화된 모델은 특정 하드웨어에 최적화되어 있기 때문에, 다양한 기기에서 더 잘 작동해요. 마치 퍼즐 조각처럼, 양자화된 모델은 특정 하드웨어에 맞춰져 있어서 호환성이 높아지는 거죠. 예를 들어, 특정 GPU나 CPU에 최적화된 양자화 모델을 사용하면, 해당 하드웨어에서 더 빠르고 효율적으로 작동할 수 있답니다.

다양한 양자화 기법: 딥러닝 모델에 최적화된 방법 선택

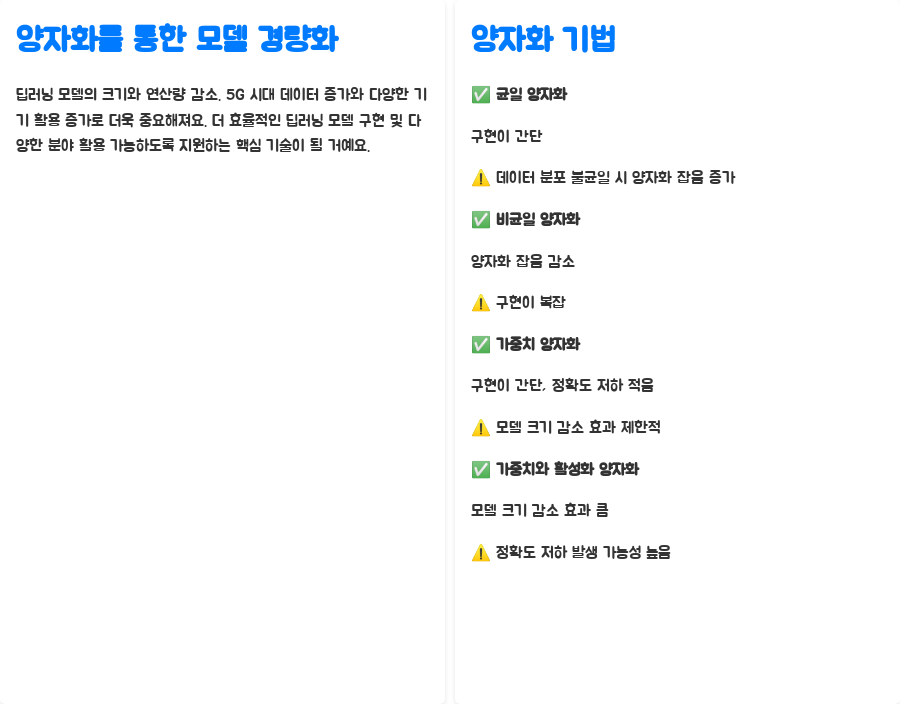

딥러닝 모델의 특성에 따라 적합한 양자화 기법을 선택하는 것이 중요해요. 몇 가지 대표적인 양자화 기법에 대해 알아볼까요?

균일 양자화 (Uniform Quantization)

균일 양자화는 가장 간단한 양자화 기법 중 하나에요. 입력 값의 범위를 균등하게 나누어 양자화 수준을 결정하는 방식이죠. 마치 자를 이용해서 길이를 측정하는 것처럼, 입력 값을 일정한 간격으로 나누어 양자화하는 거예요. 하지만 데이터 분포가 고르지 않은 경우, 양자화 잡음이 커질 수 있다는 단점이 있어요.

비균일 양자화 (Non-uniform Quantization)

비균일 양자화는 데이터 분포를 고려하여 양자화 수준을 비균일하게 설정하는 기법이에요. 마치 지형도처럼, 데이터가 많이 몰려 있는 구간은 더 세밀하게 양자화하고, 데이터가 적은 구간은 다소 덜 세밀하게 양자화하는 거죠. 덕분에 양자화 잡음을 줄일 수 있지만, 구현이 복잡해지는 단점이 있답니다.

가중치 양자화 (Weight Quantization)

가중치 양자화는 모델의 가중치만 양자화하는 기법이에요. 활성화 값은 그대로 유지하면서 가중치만 양자화해서 모델 크기를 줄이는 거죠. 마치 건물의 기둥만 강화해서 건물 전체의 무게를 줄이는 것과 비슷하다고 할 수 있죠. 가중치 양자화는 구현이 비교적 간단하고, 정확도 저하도 적은 편이라 많이 사용돼요.

가중치와 활성화 양자화 (Weight & Activation Quantization)

가중치와 활성화 양자화는 가중치와 활성화 값을 모두 양자화하는 기법이에요. 모델 크기를 더 많이 줄일 수 있지만, 정확도 저하가 발생할 수 있다는 점을 유의해야 해요. 마치 집의 벽과 지붕을 모두 가볍게 만들어서 집 전체의 무게를 줄이는 것과 같아요.

양자화 수준 선택: 정확도와 성능의 균형점 찾기

양자화 기법을 적용할 때는 정확도와 성능 간의 균형점을 찾는 게 중요해요. 8비트 양자화까지는 정확도 저하가 크지 않지만, 4비트 이하로 내려가면 정확도가 떨어질 수 있거든요. 마치 무게를 줄이려고 집의 벽을 너무 얇게 만들면 건물이 무너질 수 있는 것처럼, 양자화 수준을 너무 낮추면 모델의 성능이 떨어질 수 있어요. 따라서 모델의 목적과 요구 사항에 맞춰 적절한 양자화 수준을 선택해야 한답니다.

양자화 활용 사례: 다양한 분야에서 빛나는 효율성

양자화는 다양한 분야에서 활용될 수 있어요. 특히 연산 능력이나 메모리 용량이 제한적인 환경에서 딥러닝 모델을 효율적으로 사용해야 할 때 유용하죠.

모바일 딥러닝: 스마트폰에서도 딥러닝을!

스마트폰과 같은 모바일 기기에서 딥러닝 모델을 사용할 때, 모델 크기가 크면 앱 용량이 커지고 배터리 소모가 늘어날 수밖에 없어요. 양자화를 통해 모델 크기를 줄이면 이러한 문제를 해결하고, 스마트폰에서도 더욱 원활하게 딥러닝 기능을 활용할 수 있답니다.

임베디드 시스템: 제한된 환경에서 딥러닝 활용

자율주행 자동차, 로봇, 드론과 같은 임베디드 시스템은 제한된 하드웨어 환경에서 작동해야 하기 때문에, 모델 크기와 연산량을 최소화하는 것이 매우 중요해요. 양자화를 통해 모델을 경량화하면, 이러한 임베디드 시스템에서도 딥러닝 기술을 안정적으로 활용할 수 있답니다.

엣지 컴퓨팅: 데이터 처리의 효율성 극대화

엣지 컴퓨팅은 데이터를 클라우드로 전송하지 않고, 엣지 기기에서 바로 처리하는 기술이에요. 양자화를 통해 모델 크기와 연산량을 줄이면, 엣지 기기에서도 더 효율적으로 딥러닝 모델을 실행할 수 있고, 데이터 처리 속도를 높일 수 있답니다.

양자화를 통한 모델 경량화: 미래 딥러닝의 핵심

딥러닝 모델의 크기와 연산량을 줄이는 양자화 기술은 앞으로 더욱 중요해질 거예요. 특히 5G 시대가 도래하면서 더욱 많은 데이터가 생성되고, 다양한 기기에서 딥러닝을 활용하려는 시도가 증가하고 있거든요. 양자화는 이러한 변화에 발맞춰 딥러닝 모델을 더욱 효율적으로 만들고, 다양한 분야에서 딥러닝을 활용할 수 있도록 돕는 핵심 기술이 될 거랍니다.

| 균일 양자화 | 구현이 간단 | 데이터 분포가 고르지 않으면 양자화 잡음 증가 |

| 비균일 양자화 | 양자화 잡음 감소 | 구현이 복잡 |

| 가중치 양자화 | 구현이 간단, 정확도 저하 적음 | 모델 크기 감소 효과 제한적 |

| 가중치와 활성화 양자화 | 모델 크기 감소 효과 크 | 정확도 저하 발생 가능성 높음 |

양자화 기법 장점 단점

궁금한 점이 있으신가요?

Q1. 양자화를 사용하면 모델의 정확도가 떨어질 수 있나요?

A1. 네, 양자화를 통해 모델의 크기와 연산량을 줄이면서 정확도가 어느 정도 감소할 수 있어요. 하지만 8비트 양자화까지는 정확도 저하가 크지 않고, 최근에는 양자화 기법이 발전하면서 정확도를 유지하면서 모델 크기를 줄이는 기술들이 개발되고 있답니다.

Q2. 어떤 딥러닝 모델에 양자화를 적용하는 것이 좋나요?

A2. 모바일 기기나 임베디드 시스템처럼 연산 능력이나 메모리 용량이 제한적인 환경에서 사용되는 딥러닝 모델에 양자화를 적용하면 효과적이에요. 특히 이미지 분류, 객체 인식, 음성 인식 등과 같이 추론 속도가 중요한 모델에 양자화를 적용하면 더욱 큰 효과를 볼 수 있답니다.

Q3. 양자화를 적용하면 모델 학습 과정에도 변화가 있나요?

A3. 양자화를 적용하면 모델 학습 과정에 변화가 생길 수 있어요. 일반적으로 양자화된 모델은 학습 과정에서 정확도가 떨어지는 경우가 많아, 양자화 친화적인 학습 방법을 사용하거나 양자화 후에 미세 조정(Fine-tuning)을 통해 성능을 개선하는 것이 좋답니다.

키워드:양자화,딥러닝,모델경량화,모델압축,추론속도,딥러닝모델,모바일딥러닝,임베디드시스템,엣지컴퓨팅,머신러닝,AI,인공지능,기계학습,데이터과학,효율성,성능향상,전력소비,하드웨어,소프트웨어,GPU,CPU,비트수,정확도,트레이드오프,균일양자화,비균일양자화,가중치양자화,활성화양자화,딥러닝개발,딥러닝활용,IT,기술,정보,지식,블로그